Diffusion学习11-大一统模型

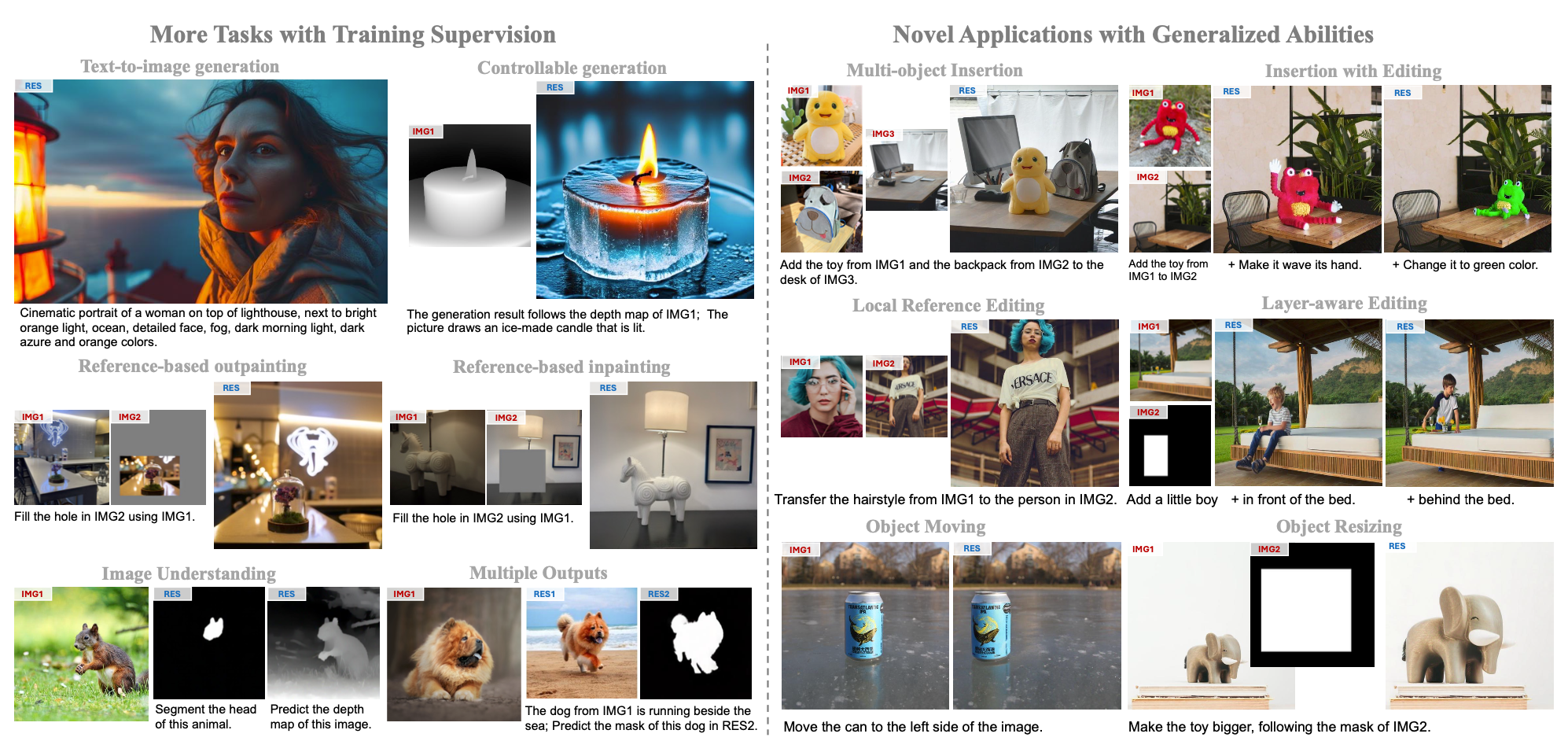

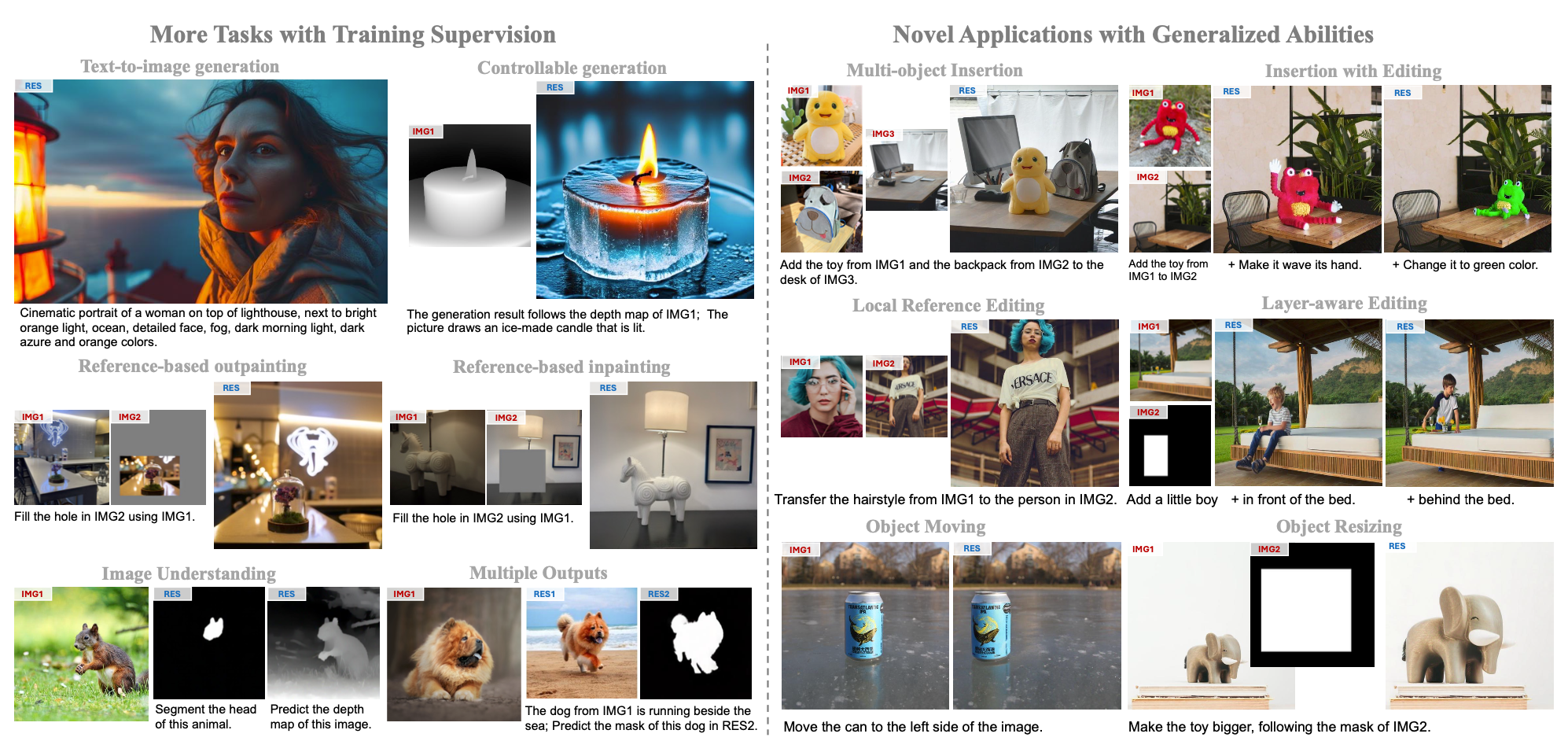

Diffusion模型在图像生成领域已经具备了优越的效果,本博客之前的很多系列篇文章也分别介绍了诸如控制生成、特征保持、风格迁移、图像编辑,但是这些能力更像是插件一样依附在强大的文生图基础模型上,在我们需要某个能力的时候从”仓库“中抽一个出来然后不用再放回去。 联想到目前LLM下统一的生成范式,一个模型可以做所有预研相关的任务(如机器翻译、情感分析等),那么自然而然会联想到图像生成领域能不能有这样一个模型,能同时完成如下图所示的可控生成、编辑、特征保持等各项任务? 大一统模型能做的任务(from.UniReal) 在这种情形下,大一统模型就应运而生,其以一个强大的backbone为基础,支持任意形式的多模态输入并同时支持以上所说的多种任务。 OmniGen 《OmniGen: Unifie..

Read more